AI를 조금만 더 실전적으로 써보기 시작하면, 꽤 자주 비슷한 순간을 만나게 됩니다.

분명히 설명을 했는데 결과가 미묘하게 다르게 나오고, 방금까지 이야기하던 흐름을 놓친 듯한 답이 나오고, 같은 작업을 다시 시키면 결과가 또 달라지는 순간들입니다.

이럴 때 사람들은 자연스럽게 이런 생각을 하게 됩니다.

“내가 분명히 말했는데, 왜 자꾸 엇나가지?”

처음에는 이걸 모델 성능이나 프롬프트 문제로만 생각하기 쉽습니다. 하지만 실제로는 꽤 많은 경우, 문제는 질문 문장 하나보다 맥락이 충분히 들어가 있지 않다는 데서 생깁니다.

즉 AI가 자꾸 엇나가는 건, 단순히 말을 못 알아들어서라기보다 지금 이 작업을 이해하는 데 필요한 배경이 부족해서일 수 있습니다.

이번 글에서는 왜 좋은 맥락이 없으면 AI가 자꾸 흔들리게 되는지, 그리고 그래서 Context Engineering이 실전에서 왜 중요해지는지를 조금 더 체감 위주로 정리해보려고 합니다.

이건 실제로 많은 사람이 겪는 문제입니다.

- 어제는 꽤 잘하던 작업이 오늘은 묘하게 엇나가고

- 같은 요청인데도 어떤 때는 방향을 잘 잡고, 어떤 때는 뜬금없는 결과가 나오고

- 한 번 더 설명하면 좋아지지만, 또 조금 지나면 맥락을 잃은 듯한 반응이 나옵니다

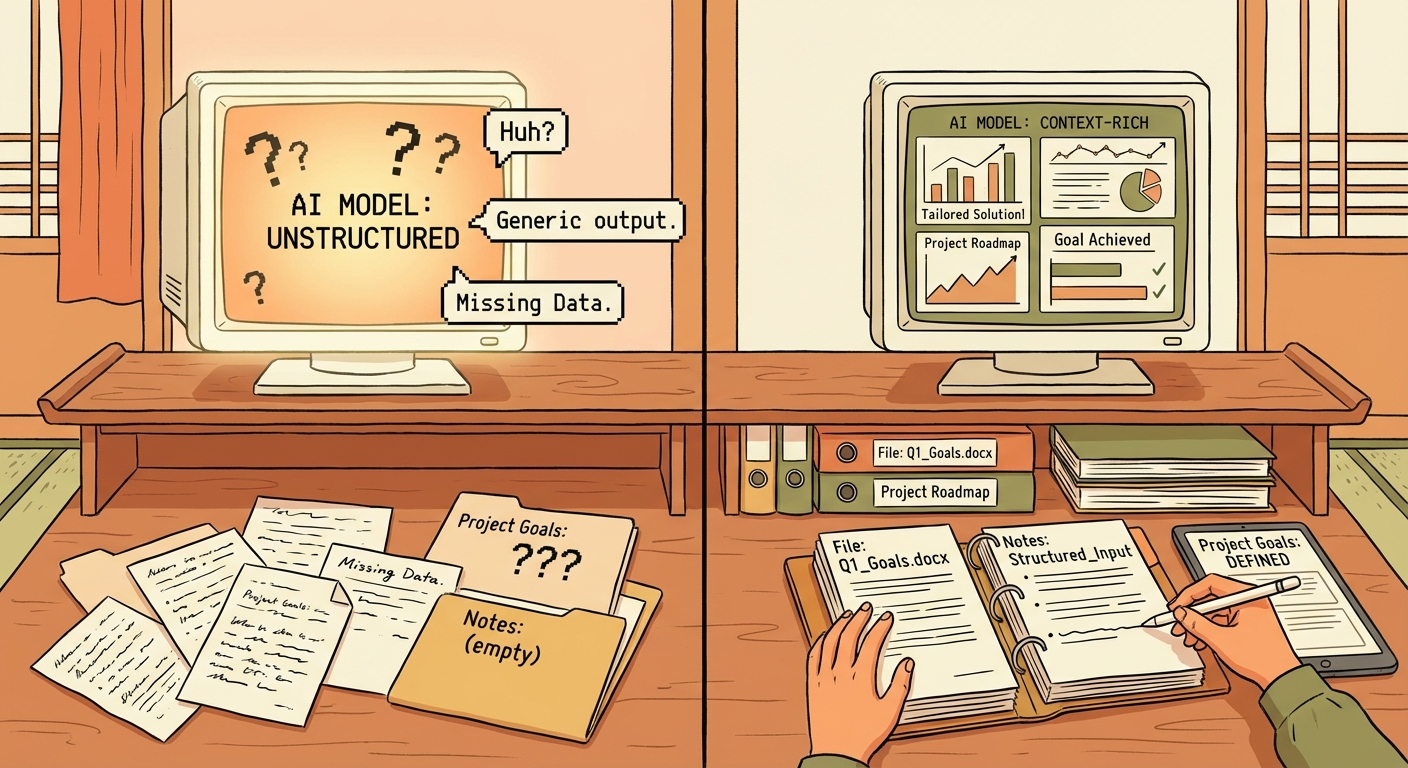

이럴 때는 AI가 불안정하다고만 느끼기 쉽습니다. 그런데 조금 더 들여다보면, 문제는 종종 AI 자체보다 지금 주어진 맥락의 밀도와 구조에 있습니다.

즉 같은 작업처럼 보여도, 실제로 AI 입장에서는:

- 지금 참고해야 할 정보가 빠져 있거나

- 이전 대화 흐름이 충분하지 않거나

- 작업 목적이 분명하지 않거나

- 어떤 기준을 우선해야 하는지 모르는 상태일 수 있습니다

그런 상태에서는 같은 요청도 자꾸 다르게 흔들릴 수밖에 없습니다.

여기서 중요한 오해가 하나 있습니다.

많은 사람이 맥락을 보강하려고 하면 먼저 설명을 더 많이 붙이는 방향으로 갑니다. 물론 그것도 어느 정도는 도움이 됩니다. 하지만 정보가 많아진다고 해서 자동으로 좋은 Context가 되지는 않습니다.

왜냐하면 AI에게 중요한 건 단순한 정보량이 아니라, 지금 이 작업을 이해하는 데 필요한 정보가 얼마나 적절하게 정리돼 있느냐에 더 가깝기 때문입니다.

예를 들어:

- 중요한 기준은 빠져 있는데 주변 설명만 길다거나

- 현재 작업과 관련 없는 정보가 너무 많다거나

- 핵심 목표보다 부가 설명이 더 앞에 있다거나

- 기준 문서와 예시가 없이 말로만 길게 설명한다거나

이런 경우에는 오히려 정보가 많을수록 더 헷갈릴 수도 있습니다.

즉 좋은 Context는 많이 넣는 것이 아니라, 필요한 것을 잘 들어가게 하는 것에 더 가깝습니다.

실전에서 AI를 쓰다 보면 자주 드는 불만 중 하나가 이겁니다.

“아까 다 설명했는데 왜 또 놓치지?”

이건 정말 흔한 체감입니다. 그런데 이 현상도 단순히 AI가 멍청해서라기보다, 맥락이 계속 안정적으로 유지되지 않기 때문에 생기는 경우가 많습니다.

예를 들면:

- 이전 대화의 핵심 기준이 흐려졌거나

- 참고해야 할 문서가 계속 같이 붙어 있지 않거나

- 지금 무엇이 중요한 작업인지 분명하지 않거나

- 사람이 알고 있는 배경이 AI 쪽에는 충분히 전달되지 않았을 수 있습니다

결국 사람 입장에서는 “이미 알고 있는 이야기”인데, AI 입장에서는 그게 항상 또렷하게 잡혀 있지 않은 상태일 수 있는 겁니다.

그래서 Context Engineering은 단순히 정보를 더 넣는 기술이 아니라, 맥락이 흔들리지 않게 잡아주는 설계 감각에 더 가깝습니다.

가벼운 질문 몇 개를 주고받는 단계에서는 이 문제가 크게 느껴지지 않을 수 있습니다. 하지만 AI를 실제 작업에 더 깊게 붙이기 시작하면 이야기가 달라집니다.

특히 이런 경우에 그렇습니다.

- 같은 프로젝트를 여러 번 이어서 다룰 때

- 시리즈 글처럼 톤과 흐름이 중요한 작업을 할 때

- 파일, 메모, 자료를 같이 봐야 할 때

- 결과 형식과 기준이 분명한 반복 작업을 맡길 때

이런 작업에서는 프롬프트 한 줄보다, 지금 어떤 배경 위에서 작업하고 있는가가 훨씬 중요해집니다.

그래서 실전으로 갈수록 사람들은 Prompt를 넘어서 Context 쪽 감각을 더 중요하게 느끼게 됩니다. 질문을 예쁘게 다듬는 것만으로는 한계가 있고, 작업의 배경 자체를 같이 설계해야 결과가 덜 흔들리기 때문입니다.

돌이켜보면 AI가 자꾸 엇나가는 순간을 단순히 “모델이 별로다”로만 설명하기 어려운 경우가 많습니다.

물론 모델 차이는 분명 존재합니다. 하지만 실전에서는 그보다 먼저, 이 AI가 지금 무엇을 알고 있고 어떤 기준 위에서 움직이고 있는가가 결과를 크게 바꾸는 경우가 많습니다.

그래서 어떤 날은 같은 모델도 훨씬 더 똑똑하고 안정적으로 느껴지고, 어떤 날은 같은 모델인데도 자꾸 맥락을 놓치는 것처럼 보입니다.

이 차이를 만드는 핵심 중 하나가 바로 Context입니다.

즉 AI가 자꾸 엇나가는 문제는 종종 프롬프트 기술의 부족이 아니라, 맥락 설계가 아직 충분히 잡히지 않았다는 신호일 수 있습니다.

그리고 바로 그 지점에서 Context Engineering은 점점 더 실전적인 중요성을 갖게 됩니다.

다음 글 예고

다음 글에서는 AI가 실제 작업 환경 안으로 들어가기 시작하면서 왜 Harness Engineering이라는 말까지 중요해지기 시작했는지, 그리고 단순히 잘 대답하는 것과 실제로 잘 일하는 것이 왜 다른지를 이어서 정리해보려고 합니다.

이 글은 AI의 도움을 받아 작성되었습니다.